SVM:寻找一条最优的分界线使得它到两边的距离 margin 都最大。

属性

描述

优点

泛化错误率低,计算开销不大,易于理解

缺点

对参数调节和核函数选择敏感,原始分类器不参加修改适合处理二类问题

适用

数值型,标称型

名词概念

名词

意义

data

数据

classifier

分类器

optimization

最优解

kernel

核函数...

以MATLAB 模拟离散点

以下为欠拟合与过拟合图示:

欠拟合

模型没有很好地捕捉到数据特征,不能够很好地拟合数据。

解决方法

添加其他特征项,有时候我们模型出现欠拟合的时候是因为特征项不够导致的,可以添加其他特征项来很好地解决。

添加多项式特征,这个在机器学习算法里面用的很普遍,例如将线性模型通过添加二次项或者三次项使模型泛化能力更强。

减少正则化参数,正则化的目的是用来防止...

原文https://www.analyticsvidhya.com/blog/2015/08/comprehensive-guide-regression/译文http://blog.csdn.net/lynnucas/article/details/47948639

回归分析 : 是一种预测性的建模技术,使用曲线拟合数据点,最终获取到数据点的距离差异最小的曲线

回归主要三个度量:...

KNN 近邻算法:测量不同特征值之间距离进行分类

属性

描述

优点

精度高,对异常值不敏感,无数据输入假定

缺点

计算复杂度高,空间复杂度高

适用

数值型,标称型

步骤

存在一个训练集,并且每个数据都存在标签

输入没有标签的新数据

将新数据与训练集特征进行比较

提取训练集中特征最相似的分类标签分类

一般只选择训练集中的前 K 个最相似数据

决策树:从属性相同的一类别事例推理树状规则分类方法

属性

描述

优点

计算复杂度不高,输出易于理解,中间值缺失不敏感,可以处理不相关特征数据

缺点

可能产生过拟合

适用

数值型,标称型

步骤

生成决策树:关键=> 选择适合的属性作为判别依据

修剪决策树:生成决策树时未考虑的噪声影响,容易出现过拟合,预测效果差,预先剪枝,后剪枝

识别叶子节点:差异较...

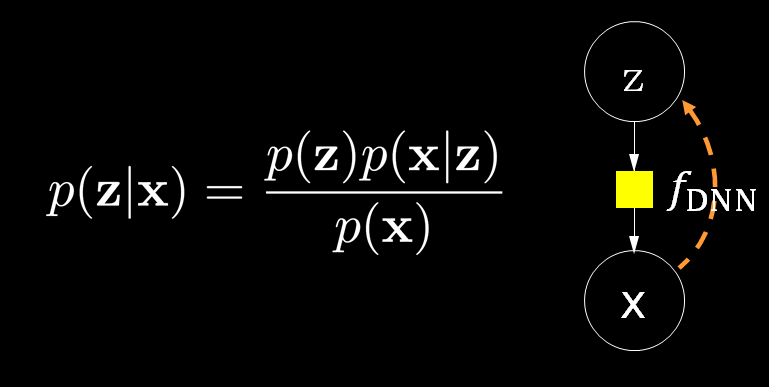

朴素贝叶斯 (Naive Bayesian) : 通过随机事件A和B的条件概率(或边缘概率)判断规则是否可信

属性

描述

优点

数据较少仍然有效,可以处理多类别问题

缺点

对于输入数据敏感

适用

标称型

公式

伪代码123456789计算每个类别特征数目对每个训练集: 对每个特征: 如果特征出现在集合中->增加该特征计数值 增加所有特征计数值 对每个特...

计算样本间的“距离”(Distance) ,估算分类时不同样本之间的相似性度量(Similarity Measurement)。

欧氏距离

曼哈顿距离

切比雪夫距离

闵可夫斯基距离

标准化欧氏距离

马氏距离

夹角余弦

汉明距离

杰卡德距离& 杰卡德相似系数

相关系数& 相关距离

信息熵

作者:Vamei 出处:http://www.cnblogs.com/vamei 欢迎转载,也请保留这段声明。谢谢!

提示:若无法正确显示 LaTeX 公式在hosts 文件中添加

161.91.161.217 chart.googleapis.com

我们了解了“样本空间”,“事件”,“概率”。样本空间中包含了一次实验所有可能的结果,事件是样本空间的一个子集,每个事件可以有一个发...

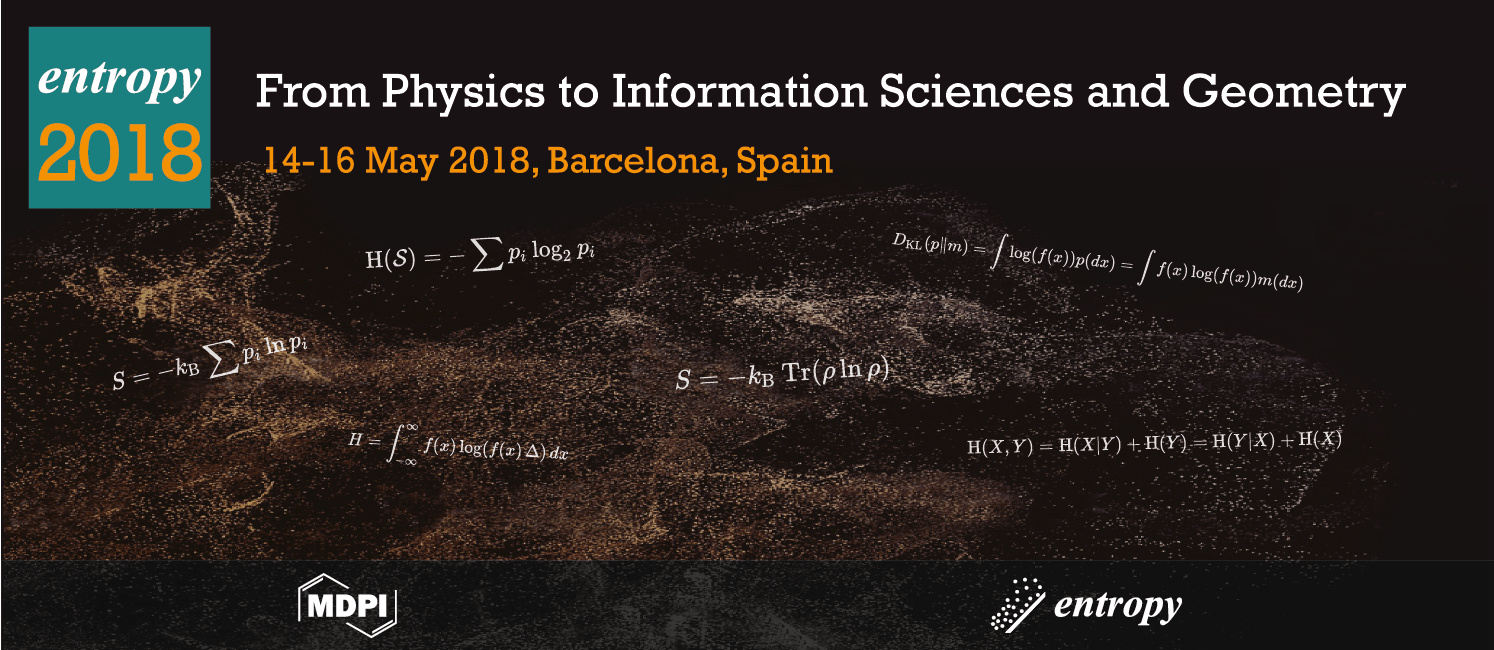

熵 (Entropy): 热力学第二定律,熵反映了状态的无序程度。范围(0~1)值越大越混乱。

物体从一种有序转变为另一种有序状态,必经过一个无序状态。无序状态程度即为熵。而为了消除这种无序使其有序,需要额外的能量。在信息中则是变量的不确定性越大,熵也就越大,把它搞清楚所需要的信息量也就越大。

一个系统越是有序,信息熵就越低;反之,一个系统越是混乱,信息熵就越高。所以,信息熵也可以说是...

使用Google Chart的服务器

提示:若无法正确打开在hosts 文件中添加

161.91.161.217 chart.googleapis.com

1<img src="http://chart.googleapis.com/chart?cht=tx&chl= 在此插入Latex公式" style="border:none;"...